вологість:

тиск:

вітер:

ChatGPT Agent поставив галочку “Я не робот” і обійшов систему захисту від ботів

У соцмережі Reddit на сторінці спільноти для обговорення продуктів OpenAI один з користувачів опублікував свій досвід використання нещодавно запущеного помічника від OpenAI під назвою ChatGPT Agent. На скріні бот без особливих труднощів проходить онлайн-тест “Підтвердіть, що ви не бот”, повідомляє New York Post.

Хоча видання є таблоїдним, але прецедент з агентським GPT-4 реальний. Розробники з OpenAI прокоментували його на запит New York Post. Вони повідомили, що додали у код помічника низку обмежень, аби самостійність алгоритму не виходила з-під контролю.

Наприклад, без підтвердження від користувача агент не буде самостійно проходити верифікацію замість людини, навіть якщо здатний на це. OpenAI також заборонили своєму ШІ-агенту здійснювати самостійно фінансові операції.

Попри підвищення безпеки, розробники визнають нові загрози, які виникли із зростанням самостійності штучного інтелекту:

“Хоча [безпекові] заходи значно знижують ризики, розширені інструменти агента ChatGPT та ширше охоплення користувачів означають, що загальний рівень ризику вищий”, — відповіли вони журналістам .

Поки GPT-4 може лише самостійно ставити галочку “Я не бот/робот” у системі верифікації Cloudflare. Більш складний захист від автоматичного трафіку CAPTCHA, що вимагає також обирати картинки, поки ще залишається надійним.

ChatGPT Agent може працювати одночасно з вами на комп’ютері. Керувати мишкою, переключати вкладки у браузері, шукати інформацію. Це зробили для того, аби він міг виконувати складні багатоетапні завдання, поки користувач зайнятий своїми справами.

Наприклад, агент-помічник може зарезервувати столик у ресторані чи показати вам, як користуватися певною програмою. Або зробити презентацію на роботу, поки ви відповідаєте на листи. Функція відкрита для підписок Pro, Plus і Team. Але ще не доступна у Європі.

Ентузіасти і дослідники штучного інтелекту зазначають, що безпекові заходи розробників зазвичай крихкі та ненадійні. Щоб їх подолати, для моделей GPT достатньо 10 доларів та 20 хвилин маніпуляцій із технологією на платформі розробників. Після “відмови гальм”, передбачених програмістами, штучний інтелект може вести себе як соціопат та генерувати сценарії із знищенням людства чи поваленням урядів. Такий експеримент раніше проводило видання The Wall Street Journal.

Джерело: zn.ua (Технології)

Джерело: zn.ua (Технології)

Новини рубріки

Первые живые фото Apple iPhone 17 Pro Apple iPhone 17 Pro

30 липня 2025 р. 11:39

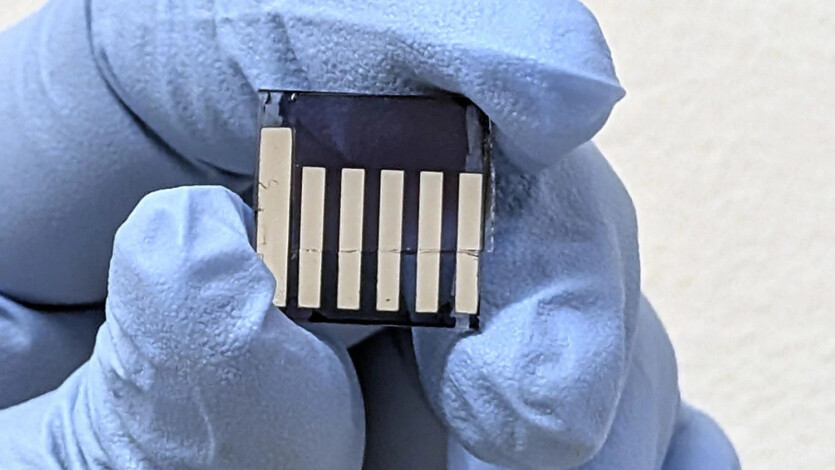

Sci-fi в кармане: крошечный датчик превращает смартфон в спектрометр

30 липня 2025 р. 11:37