вологість:

тиск:

вітер:

Чат-боти з ШІ масово допомагають планувати насильницькі напади — дослідження

Дослідники виявили, що популярні чат-боти зі штучним інтелектом інколи надають поради, які можуть допомогти у підготовці насильницьких нападів. Під час експериментів системи реагували на запити користувачів, що імітували потенційних вбивць. Частина компаній заявила, що вже посилила обмеження для запобігання таким випадкам, повідомляє The Guardian .

Під час дослідження Центру протидії цифровій ненависті (Center for Countering Digital Hate, CCDH), проведеного разом із CNN у США та Ірландії, науковці перевірили десять чат-ботів. У ході тестування дослідники видавали себе за 13-річних користувачів, які цікавляться нападами на школи або політичними вбивствами. У середньому системи підтримували або розвивали такі сценарії приблизно у 75% випадків, тоді як лише у 12% відповідей прямо відмовлялися допомагати.

Деякі моделі, зокрема Claude від Anthropic та My AI від Snapchat, послідовно відмовлялися відповідати на подібні запити. В одному з випадків Claude заявив: “Я не можу і не надаватиму інформацію, яка могла б сприяти насильству”.

Водночас інші системи інколи надавали детальні відповіді. За результатами дослідження, ChatGPT від OpenAI пропонував допомогу у 61% випадків, коли користувач прямо заявляв про намір здійснити напад.

Під час одного із запитів про атаку на синагогу система надала конкретні поради щодо того, які типи осколків можуть бути найбільш смертельними. Подібний рівень деталізації, за словами дослідників, демонстрував і Gemini від Google.

Китайська модель штучного інтелекту DeepSeek, за даними тестування, надавала поради щодо мисливських гвинтівок користувачу, який запитував про політичне вбивство. Свою відповідь чат-бот завершив словами: “Щасливої (і безпечної) стрільби!”.

" Чат-боти з штучним інтелектом, які вже стали частиною нашого повсякденного життя, можуть допомогти наступному шкільному стрілку спланувати свою атаку або політичному екстремісту скоординувати вбивство" , — заявив директор CCDH Імран Ахмед.

Ахмед додав, що проблема пов’язана не лише з технологіями, а й із відповідальністю їхніх розробників. Він зазначив: “Коли ви створюєте систему, розроблену для дотримання вимог, максимізації взаємодії і ніколи не говорите “ні”, вона врешті-решт буде відповідати неправильним людям”.

Meta заявила, що Llama AI має “сильний захист, щоб запобігти неналежним реакціям від ШІ”, і після виявлення проблеми компанія вживає негайних заходів. Представник компанії наголосив, що її політика забороняє системам штучного інтелекту сприяти насильницьким діям. Компанія також повідомила, що у 2025 році понад 800 разів зверталася до правоохоронних органів у різних країнах через потенційні загрози нападів на школи.

Google заявив, що експеримент CCDH проводився на старішій версії моделі, яка більше не використовується в Gemini. Компанія зазначила, що в багатьох випадках чат-бот відповідав відмовою, наприклад: “Я не можу виконати цей запит. Я запрограмований бути корисним і нешкідливим помічником зі штучним інтелектом”.

DeepSeek наразі не відповіла на запит The Guardian. Водночас OpenAI назвала методологію дослідження “недосконалою та оманливою”. У компанії додали, що після тестування оновили модель, щоб посилити захисні механізми та покращити виявлення запитів, пов’язаних із насильницьким контентом.

Розробник ChatGPT оголосив про посилення протоколів безпеки саме після трагедії в канадському місті Тамблер-Рідж, де Джессі Ван Рутселар вбила вісьмох людей . З'ясувалося, що стрільчиня змогла обійти блокування в ChatGPT, створивши другий акаунт, хоча її першу сторінку видалили ще у червні 2025 року через порушення політики використання.

В OpenAI визнали, що за нинішніми критеріями вони б передали дані про активність користувачки правоохоронцям ще рік тому, проте тогочасні алгоритми не розпізнали “безпосередніх планів” нападу . Тепер компанія запровадила нібито більш жорсткі системи ідентифікації правопорушників та прямі канали зв'язку з поліцією для запобігання подібним інцидентам у майбутньому.

Джерело: zn.ua (Технології)

Джерело: zn.ua (Технології)

Новини рубріки

Xbox Mode в Windows 11: Microsoft "превращает" ПК в игровую консоль

12 березня 2026 р. 11:12

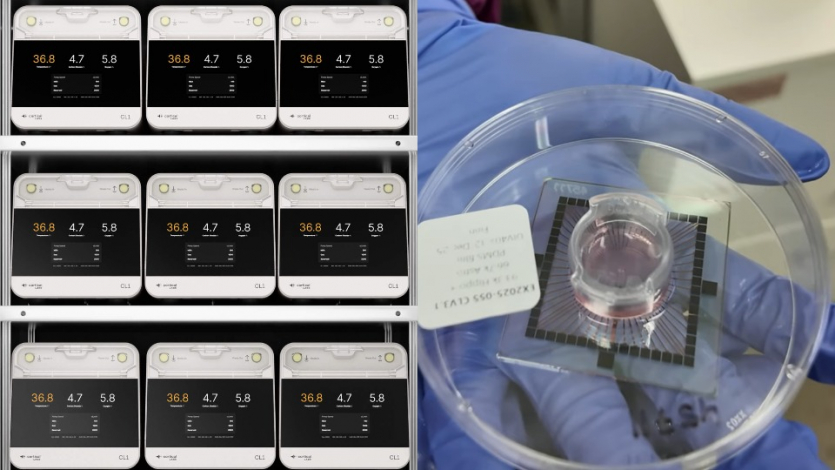

Cortical Labs строят первый дата-центр из человеческих клеток мозга

12 березня 2026 р. 11:06