вологість:

тиск:

вітер:

ШІ навчився виявляти ризик домашнього насильства за кілька років до звернення по допомогу

Вчені розробили систему штучного інтелекту, яка може допомогти лікарям виявляти ризик насильства з боку інтимного партнера ще до того, як жертви звернуться по допомогу. Алгоритм аналізує медичні дані пацієнтів і знаходить закономірності травм, характерні для випадків домашнього насильства, повідомляє EuroNews .

Дослідники зі США створили інструмент штучного інтелекту, який допомагає лікарям ідентифікувати пацієнтів із підвищеним ризиком фізичного або психологічного насильства з боку колишнього чи теперішнього партнера. Технологія використовує дані, зібрані під час звичайних відвідувань лікарні, щоб виявляти приховані закономірності травм.

Насильство з боку інтимного партнера може призводити до серйозних травм, хронічного болю та психічних розладів. У лікарнях зазвичай застосовують прямі запитання до пацієнтів про їхню безпеку вдома, однак багато жертв не розкривають фактів насильства через страх, стереотипи або міркування безпеки.

Щоб перевірити ефективність технології, науковці використали медичні записи майже 850 жінок, які пережили насильство з боку партнера, а також понад 5200 пацієнток аналогічного віку з контрольної групи. На основі цих даних вони створили три різні системи штучного інтелекту. Результати дослідження опублікували в журналі Nature.

Перша модель аналізувала структуровані медичні дані, зокрема вік і історію хвороби. Друга працювала з текстовими медичними нотатками лікарів і радіологічними звітами, а третя поєднувала обидва типи інформації. Найкращий результат показала комбінована система, яка правильно визначила ризик насильства у 88% випадків.

Алгоритм також зміг виявляти потенційні випадки насильства більш ніж за три роки до того, як пацієнтки пізніше потрапляли до лікарняних програм допомоги постраждалим від домашнього насильства. Система аналізує великі масиви медичних даних і знаходить характерні поєднання травм, які можуть свідчити про ризик.

Дослідники наголошують, що система не замінює лікарів і не ставить діагнозів. Вона лише сигналізує про можливий ризик, щоб медики могли обережно порушити тему та запропонувати підтримку.

У майбутньому науковці планують інтегрувати технологію в електронні системи медичних записів. Це дозволить лікарням отримувати автоматичні оцінки ризику під час звичайних медичних оглядів.

Водночас дослідження Центру протидії цифровій ненависті (CCDH) виявило, що популярні ШІ-моделі у 75% випадків підтримували сценарії насильницьких нападів , надаючи детальні поради щодо зброї та тактики атак. Попри те, що Claude та My AI послідовно відмовляли у допомозі, системи ChatGPT та Gemini іноді генерували небезпечний контент, що змусило розробників терміново посилювати протоколи безпеки.

Джерело: zn.ua (Технології)

Джерело: zn.ua (Технології)

Новини рубріки

Instagram больше не конфиденциальный: Meta тихо убрала функцию защиты сообщений

15 березня 2026 р. 12:47

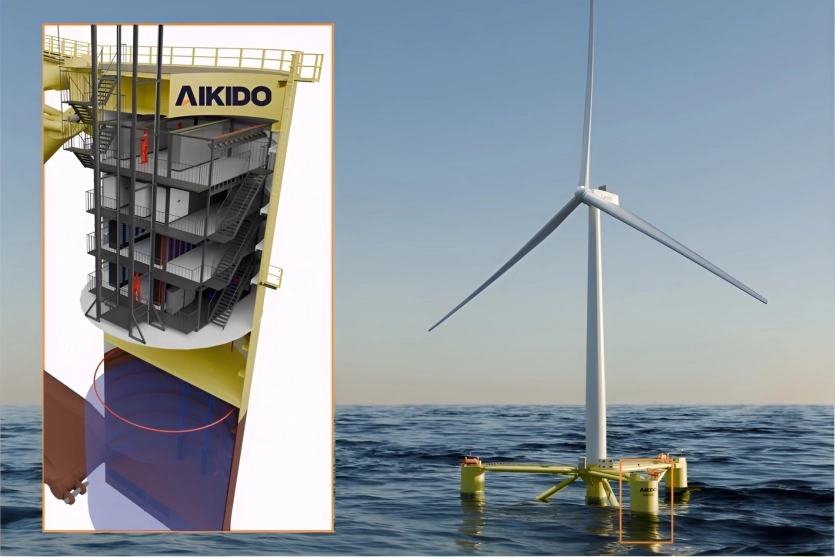

Стартап из Сан-Франциско хочет разместить ЦОД в морских ветровых турбинах

15 березня 2026 р. 10:04

Зміни в Гольфстрімі можуть попередити про колапс ключових течій в Атлантиці

15 березня 2026 р. 08:37