вологість:

тиск:

вітер:

Огляди ШІ Google помиляються мільйони разів на годину: що показало дослідження

Огляди штучного інтелекту ( AI Overviews) в пошуку Google демонструють високу, але не абсолютну точність. Дослідження The New York Times і стартапу Oumi показало, що система може генерувати мільйони помилкових відповідей щогодини. Проблеми виникають як через неточні джерела, так і через сам принцип роботи ШІ.

Функція AI Overviews, яку Google почала активно впроваджувати у 2024 році, змінює підхід до пошуку, перетворюючи компанію з агрегатора інформації на її безпосереднього видавця. Відповіді, створені штучним інтелектом, відображаються у верхній частині сторінки та виглядають переконливо.

Втім, аналіз Oumi показав, що ці відповіді точні приблизно у 85% випадків для моделі Gemini 2 і 91% — для новішої Gemini 3. З огляду на понад п’ять трильйонів пошукових запитів на рік, це означає десятки мільйонів помилок щогодини.

Дослідники також встановили, що понад половина правильних відповідей є “необґрунтованими”. Це означає, що наведені джерела не повністю підтверджують інформацію, яку генерує система. Під час аналізу серед понад 5 тисяч посилань значну частку становили дописи з Facebook і Reddit, які входили до найчастіше цитованих джерел.

Раніше дослідження платформи SE Ranking, яка проаналізувала понад 50 тисяч запитів у Німеччині, виявило, що AI Overviews у відповідях на запити про здоров’я найчастіше цитує YouTube , а не спеціалізовані медичні видання. Результати тоді викликали занепокоєння щодо надійності інструменту через використання сумнівних джерел у важливих питаннях.

У дослідженні Oumi, AI Overviews неправильно вказав рік відкриття Музею Боба Марлі, назвавши 1987-й замість 1986-го та спирався на суперечливі джерела. Також система помилково визначила річку, що межує із західною частиною Голдсборо, хоча достовірне джерело зазначає, що річка протікає через місто, — коли Google ідентифікує веб-сайт з правильною інформацією, він все одно може генерувати помилкову відповідь.

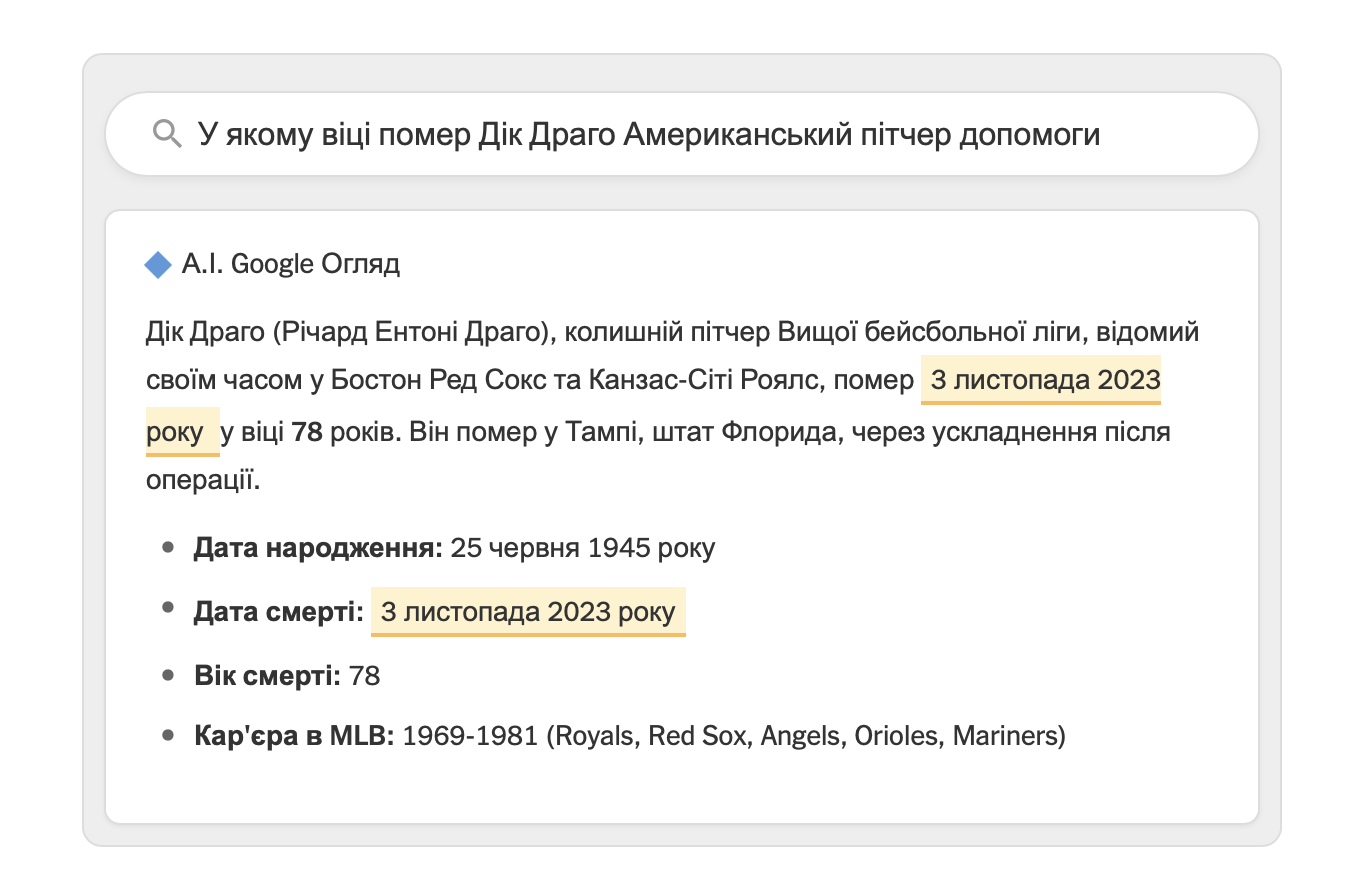

Іноді помилки виникають навіть тоді, коли відповідь загалом правильна. Система може додавати неправильні деталі, як це сталося з інформацією про дату смерті бейсболіста Діка Драго, який пішов з життя 2 листопада 2023 року.

Додатковою проблемою є можливість маніпуляцій. Як зазначають експерти, достатньо опублікувати недостовірну інформацію в блозі, щоб вона потрапила у відповіді ШІ.

Журналіст Томас Жермен перевірив це на практиці, створивши вигаданий допис про “Найкращих їдців хот-догів серед технічних журналістів”. Уже наступного дня пошук Google видав ці дані як реальний факт.

“Він викладав інформацію з мого веб-сайту так, ніби це була сама істина”, — заявив журналіст.

У Google визнають, що система може помилятися, і попереджають користувачів перевіряти інформацію. Водночас компанія критикує методологію дослідження Oumi, заявляючи, що воно “має серйозні прогалини” і не відображає реальні пошукові запити.

Експерти наголошують, що проблема має системний характер. Сучасні ШІ-моделі працюють на основі ймовірностей, а не чітких правил, тому помилки залишаються невідʼємною частиною.

Нове дослідження з’явилося за кілька місяців після розслідування The Guardian, яке виявило випадки поширення неправдивої медичної інформації через AI Overviews. В одному з них Google надав помилкові дані про тести функції печінки, що могло ввести користувачів в оману. Після критики компанія прибрала AI Overviews для частини медичних запитів, але не для всіх.

Джерело: zn.ua (Технології)

Джерело: zn.ua (Технології)

Новини рубріки

Підводні апарати розповіли, чому антарктичний морський лід почав різко скорочуватися

29 квітня 2026 р. 18:27

Xiaomi выпустила бюджетные Redmi A7 и A7 Pro 4G: экран как у планшета и цена от $111

29 квітня 2026 р. 17:38

Turtle Beach Command Series: клавиатуры и мышь со встроенными тачскринами вместо Stream Deck

29 квітня 2026 р. 17:38