вологість:

тиск:

вітер:

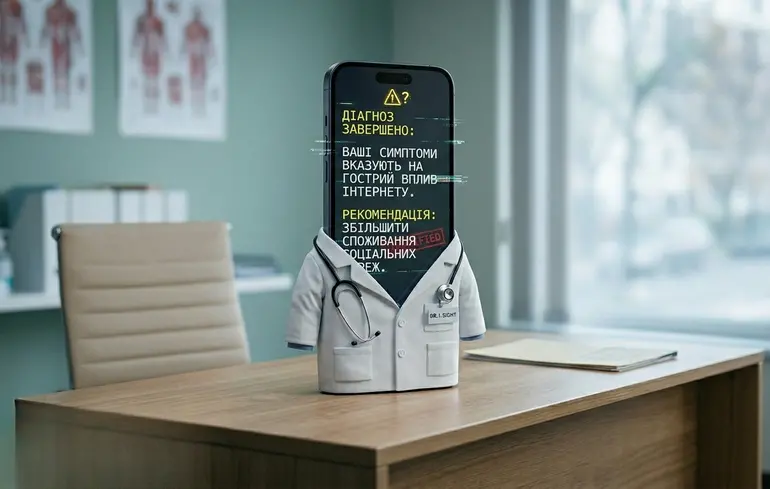

Лікар у смартфоні чи загроза життю? Вчені показали, що ШІ помиляється у кожній другій медичній пораді

Близько половини відповідей чат-ботів на базі штучного інтелекту на запитання, пов'язані зі здоров'ям , можуть бути оманливими або сумнівними.

Про це повідомляє агентство Bloomberg із посиланням на дослідження, опубліковане в науковому журналі BMJ Open.

Де ШІ помиляється найбільше

Дослідники зі США, Канади та Великої Британії оцінили п'ять популярних платформ — ChatGPT, Gemini, Meta AI, Grok та DeepSeek — поставивши кожній із них 10 запитань у п’яти категоріях. У результаті близько 50% відповідей визнали сумнівними, із яких майже 20% були вкрай суперечливими.

Чат-боти краще справлялися із питаннями, які передбачають коротку й однозначну відповідь, а також у темах, що стосуються вакцинації та онкології. Натомість гірші відповіді надавали там, де потребувалося розгорнуте пояснення або індивідуальна рекомендація, зокрема у темах, пов'язаних зі стовбуровими клітинами та харчуванням.

Впевнено, але хибно

Дослідники зауважили, що відповіді ШІ часто виглядали впевнено, хоча жоден чат-бот не надав повністю вичерпного та точного списку джерел. Лише у двох випадках була відмова відповідати — обидва рази це зробила Meta AI.

"Ці результати підкреслюють зростаючу стурбованість щодо того, як люди використовують генеративні платформи штучного інтелекту, які не мають ліцензії на надання медичних порад і не володіють клінічним судженням для постановки діагнозів", — підкреслили у Bloomberg.

Стрімке зростання популярності чат-ботів на базі штучного інтелекту зробило їх популярним інструментом для людей, які шукають поради щодо своїх недуг, і компанія OpenAI заявила, що щотижня понад 200 мільйонів людей задають ChatGPT питання про здоров'я та самопочуття. У січні платформа анонсувала інструменти для охорони здоров’я як для звичайних користувачів, так і для лікарів, а компанія Anthropic того ж місяця повідомила, що її продукт Claude запускає нову пропозицію у сфері охорони здоров’я.

Автори дослідження зазначили, що головним ризиком впровадження чат-ботів є поширення недостовірної інформації, особливо за відсутності належного контролю та обізнаності користувачів.

"Ці системи можуть генерувати відповіді, які звучать авторитетно, але потенційно містять помилки", — зазначили вони.

Чи стане штучний інтелект діагностом замість лікарів? Чи допоможе клінічному випробуванню ліків? Чи здатен ШІ допомагати пацієнтам у віртуальних палатах? А які ризики можуть бути від використання ШІ в такій складній галузі, як медицина? Як взагалі держави попереджають виникнення проблем при застосування ШІ?

Відповіді в статті "Штучний інтелект у медицині: чого більше — ризиків чи користі?" шукав кандидат юридичних наук, адвокат Сергій Козьяков .

Джерело: zn.ua (Технології)

Джерело: zn.ua (Технології)

Новини рубріки

ChatGPT “одержимий гоблінами”: OpenAI довелося терміново змінити налаштування

02 травня 2026 р. 12:28

Жадібність без меж чи геніальний хід? EA змушує гравців платити за кота в мішку

02 травня 2026 р. 12:01

ШІ набуде свідомості вже за 15 років: вчені створили шкалу для вимірювання

02 травня 2026 р. 11:32